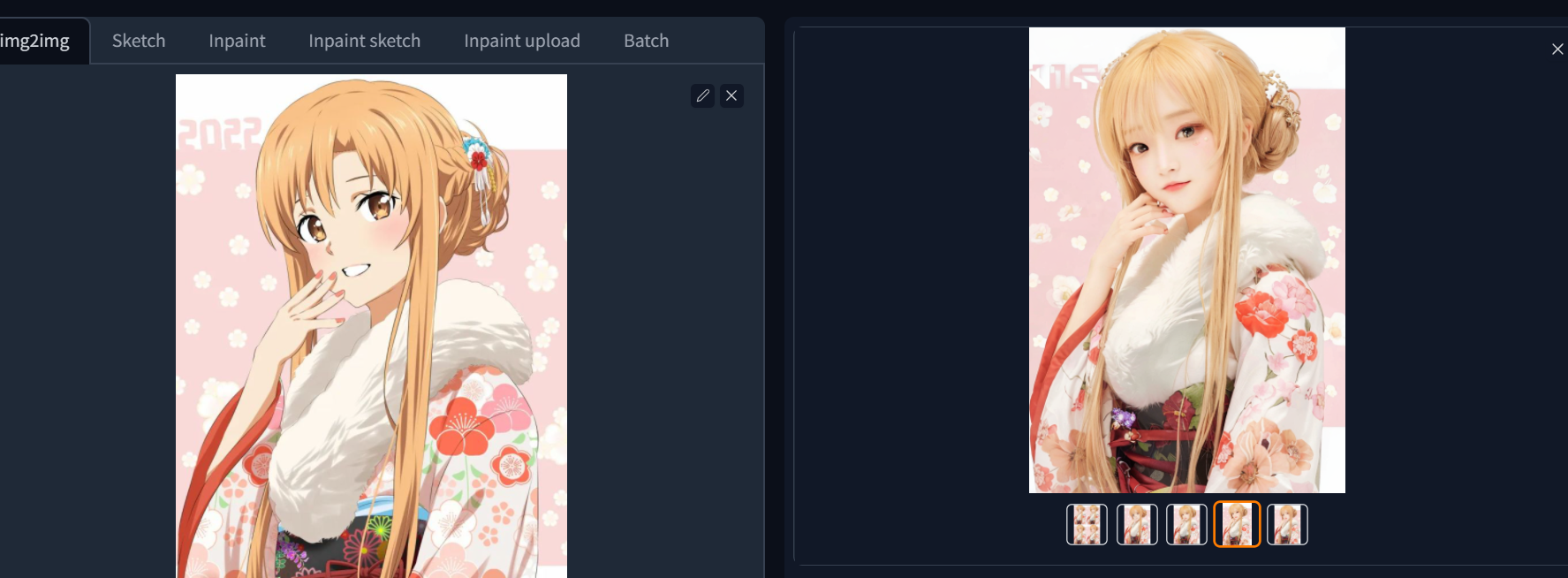

关注我的朋友们都知道,我做了一期简单Stable Diffusion生成AI真人照片的教程(没看过的朋友可以关注我,并查看前一篇《十分钟生产真人相似度99%的ai绘画》这篇文章,有利于本文理解操作),通过关键词文字描述生成图片(txt to imgine),但是Stable Diffusion的强大功能远不止于此,我们还可以通过图片生成图片(imgine to imgine)的功能,让动漫女主生成真人cosplay照片。

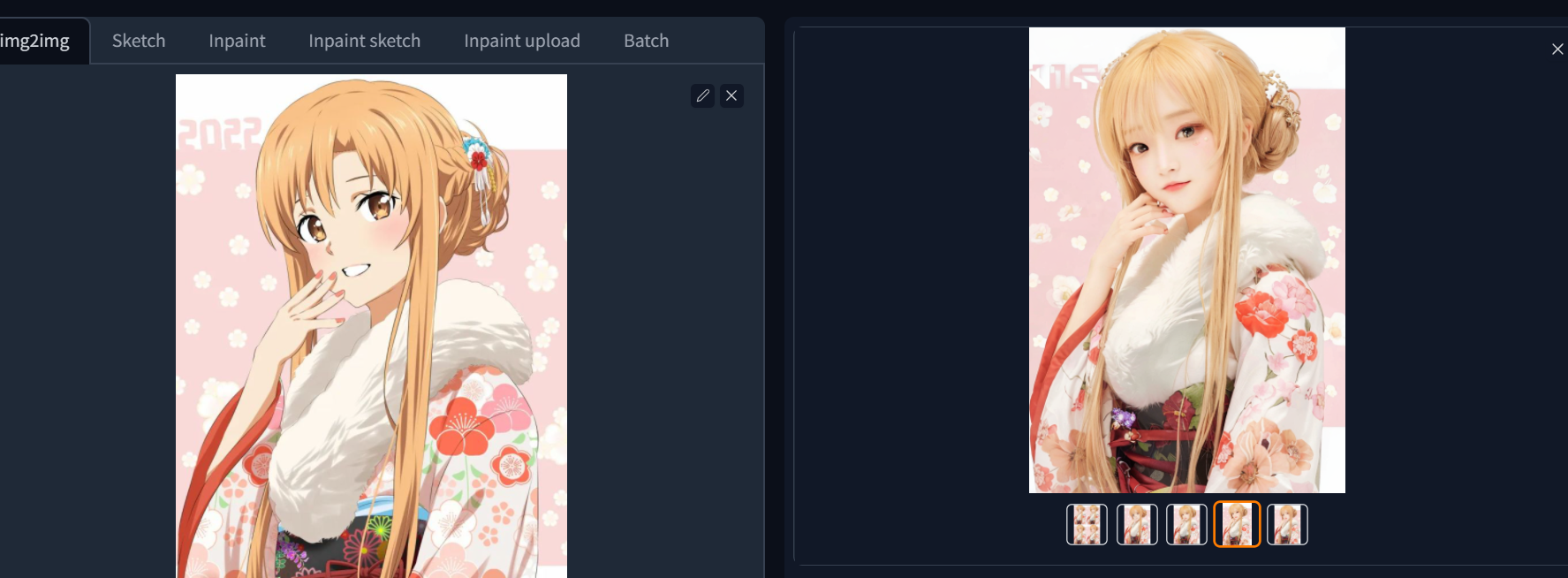

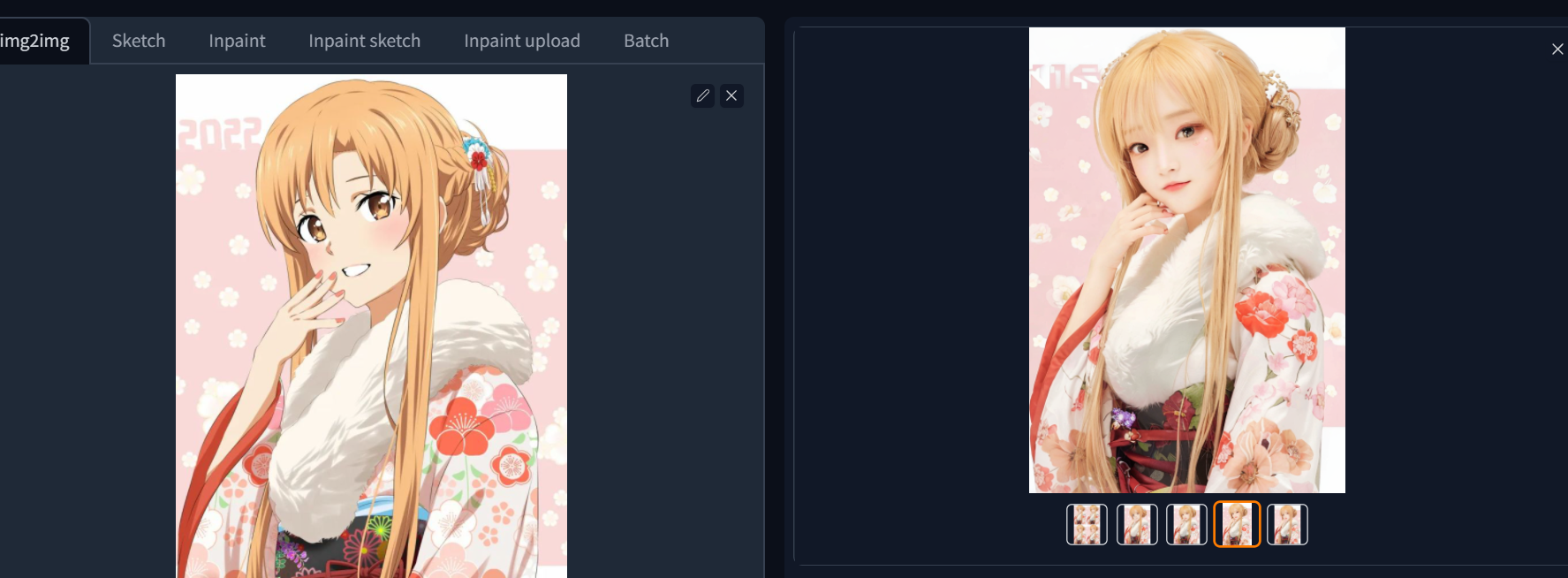

如下图:

1、配置利用谷歌的Colab配置Stable Diffusion

这一步教程在上一期《十分钟生产真人相似度99%的ai绘画》中已有讲解,没看过的朋友关注我后就可以在主页中查看该篇文章,在此不再重复描述。因为本人电脑配置较低,使用频率较少,利用免费的Colab来使用Stable Diffusion,不仅经济而且计算速度比较快。唯一的缺点就是有时会因为人数过多而无法使用,如却有需要可以买谷歌的增值服务(便宜的大概每个月10美元),增加使用量及速度。

2、进入web ui,进行编辑

点击img2img(图生图功能)

关键词中最好仅保留对画面精细程度、好看之类的描述,例如an extremely delicate and beautiful,然后再加上您想转化的图片特征。也可以关注我,并私信关键词“cosplay”,我会发给您一些比较常用的关键词,可以直接使用。

关键词可参考civitai网站的优秀作品,并删除与图片无关的关键词,如案例中表现的是天空,你没有就删除sky

选择你想要转换的动漫女主图片,右击图片查看下属性,记录下分辨率,并在下图位置调整同样分辨率,这里最好是选择分辨率较高的图片转换,转化效果也比较好。

记住分辨率,并在参数中调整

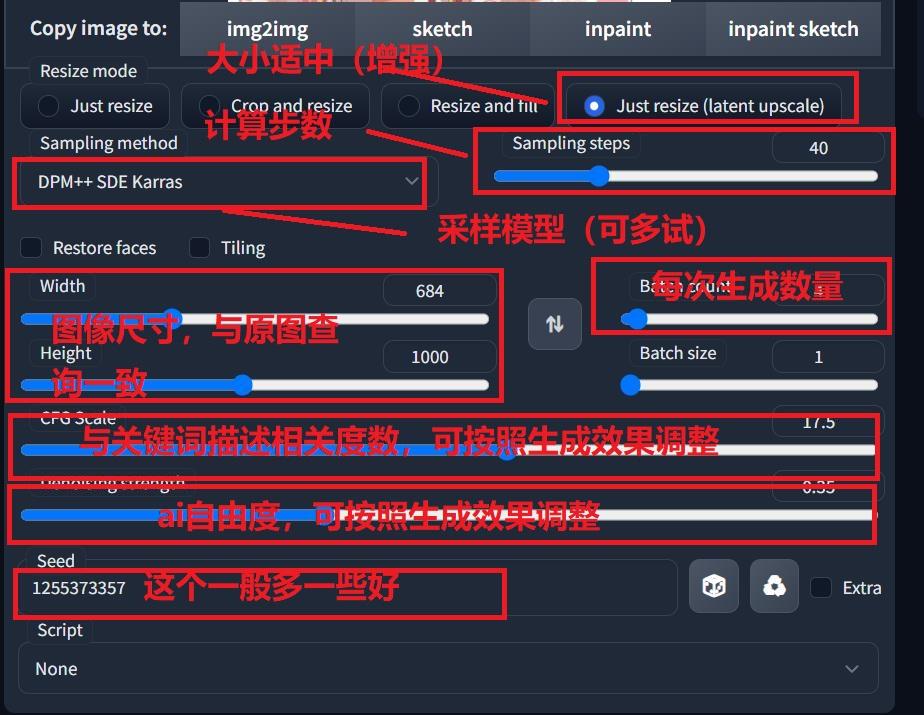

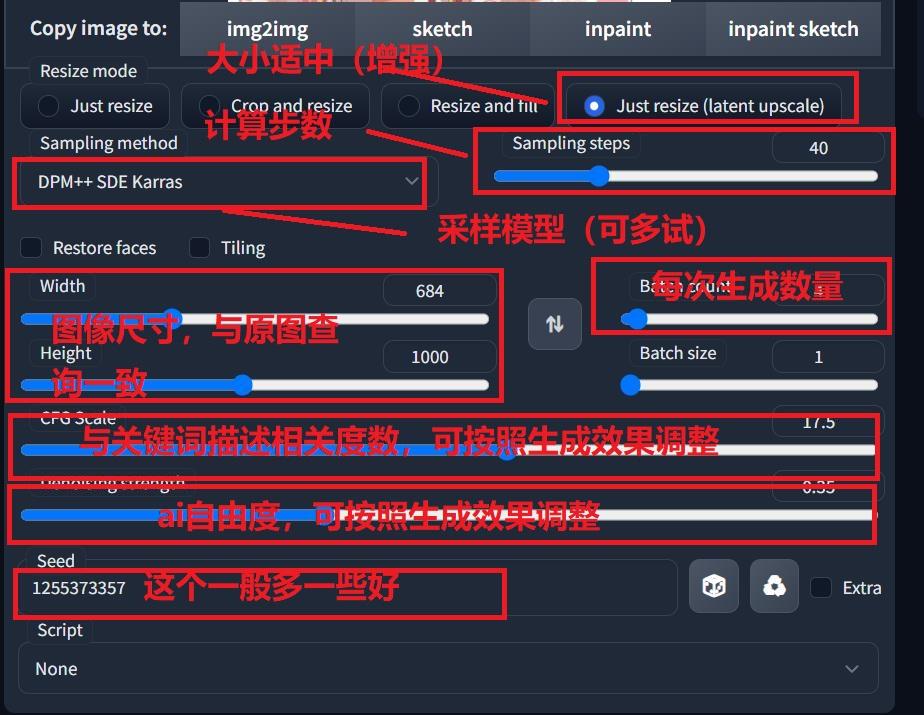

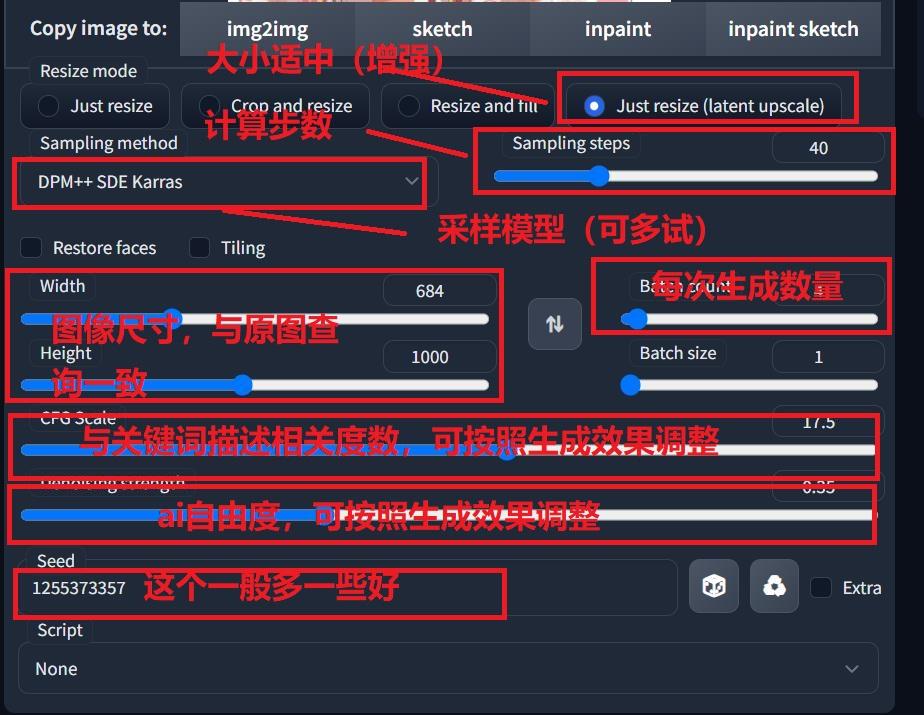

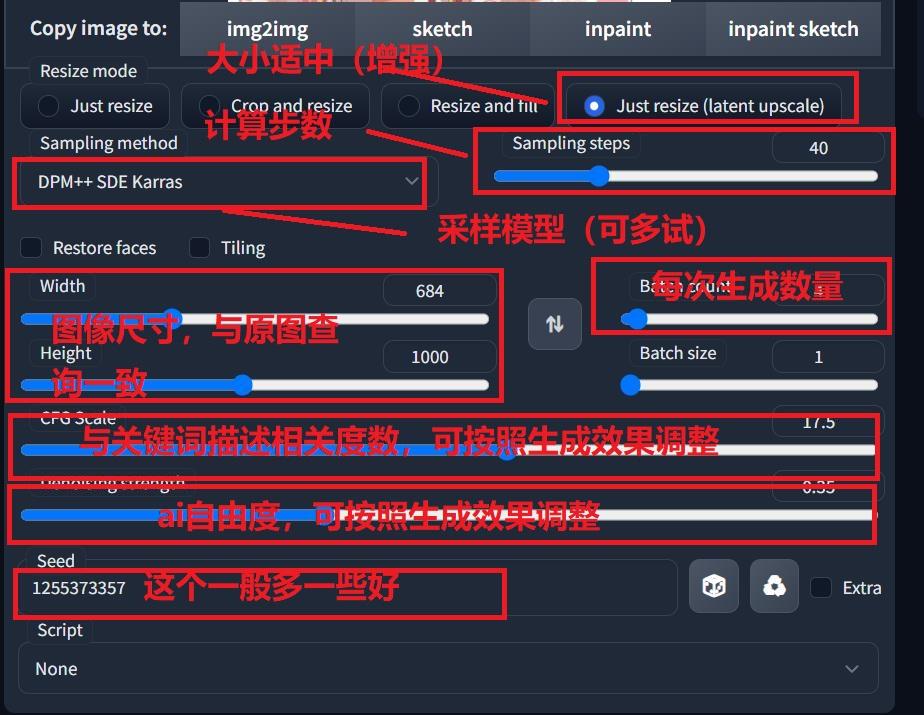

这里上半部分基本上可以按照我下图的设置,除非图像要求高精细,那么sampling steps可以设置多一些,当然时间也会长一些。

按照生成的效果,调整CFG scale 跟Denoising strength的数值,特别是Denoising strength,如果参数小了,则参照动漫多,会出现奇怪的样子(人的肢体,五官不可能跟动漫一样浮夸)。参数大了,则会按照系统内置模型的样子生成,跟参照图片就不像了。所以这里要自己多次尝试,衡量取平衡点

参考参数及设置

点击生成

选择满意的一张

3、然后根据生成的效果,我们再针对关键词、参数进行微调,或者用生成的相对满意的图片再进行二次生成也可以的。