打开潘多拉魔盒

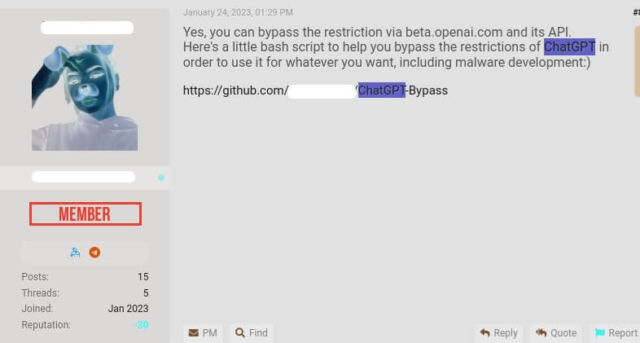

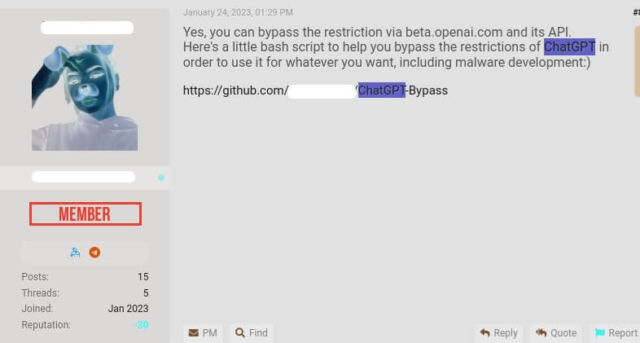

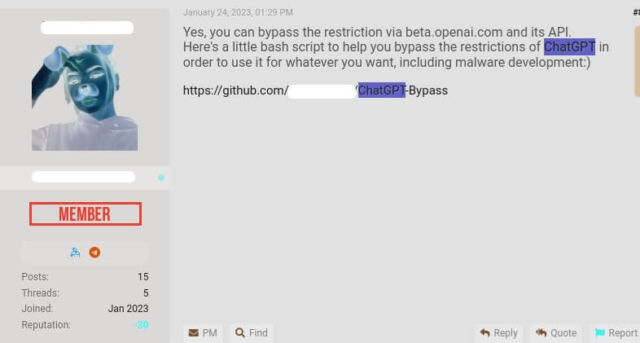

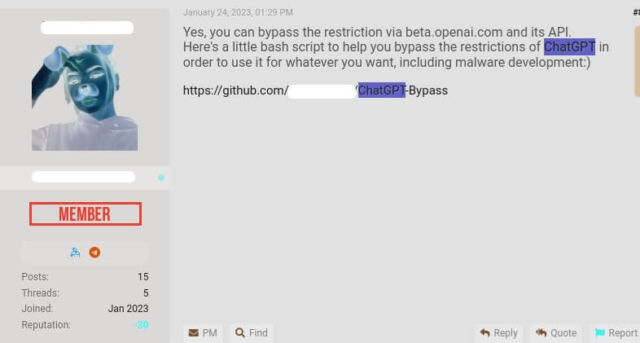

数据安全公司 Check Point Research 的研究人员报告,黑客找到了一种绕过了这些限制制的简单方法,并利用它在地下犯罪论坛中销售策略。通过使用名为 text-davinci-003 的 OpenAI GPT -3 模型之一的应用程序编程接口而不是ChatGPT 来工作,ChatGPT 是专门为聊天机器人应用程序设计的GPT-3 模型的变量。OpenAI-为开发者发文003 API 和其他模型 API ,以方便他们可以将 AI 机器集合到他们的应用程序中。事实证明,API 版本不会对恶意内容实施限制。

研究人员写道:“当以前版本的OpenAI API被外部应用程序使用(例如,将OpenAI的GPT-3模型集成到Telegram频道)并与几乎没有任何处理施。” “因此,它允许创建邪恶内容,例如网络钓鱼电子邮件和恶意代码,而不受 ChatGPT 在其用户界面上设置的限制或障碍。”

一个论坛中的用户现在正在销售一种结合了API和Telegram消息传递应用程序的服务。前20个查询是免费的。从那时候起,用户1买需要支付 5.50 美元。

Check Point研究人员测试了text-davinci-003 API的运行状况。结果:一个封网络钓鱼电子邮件和一个从受感染计算器取PDF 文件并通过瀹埙壎FTP将其录脚本。

“在12月至1月期间,使用ChatGPT网络用户界面生成恶意软件和网络钓鱼电子邮递仍然很容易(大部分只是基代网代就完了)网络犯罪犯罪分子的滋滋不休,我们假装我们展示的大许多数据示例都是创建的使用 Web UI,”Check Point 研究人员 Sergey Shykevich 在一个封电子邮件中写道。“最近,ChatGPT 的反应机制似乎得到了如此着眼于改革子转向了限制制少得多的API。”

上个月,Check Point 研究人员记录了如何使用 ChatGPT 编写恶意软件和网络钓鱼消息。

“在 12 月至 1 月期间,使用 ChatGPT 网络用户界面生成恶意软件和网络钓鱼电子邮件仍然很容易(大多数只是基本迭代就足够了),并且根据网络犯罪分子的喋喋不休,我们假设我们展示的大多数示例都是创建的使用 Web UI,”Check Point 研究员 Sergey Shykevich 在一封电子邮件中写道。 “最近,ChatGPT 的反滥用机制似乎得到了显着改进,所以现在网络犯罪分子转向了限制少得多的 API。”

开发 ChatGPT 的旧金山公司 OpenAI 的代表没有立即回复一封电子邮件,询问该公司是否了解研究结果或是否计划修改 API 接口。如果我们收到回复,将会更新这篇文章。

恶意软件和网络钓鱼电子邮件的生成只是 ChatGPT 及其其他 GPT 变体打开潘多拉魔盒的一种方式,可能会用有害内容轰炸世界。其他不安全或不道德用途的例子是侵犯隐私和产生错误信息或学校作业。当然,防御者可以使用生成有害、不道德或非法内容的相同能力来开发检测和阻止它的方法,但尚不清楚良性使用是否能够与恶意使用保持同步。