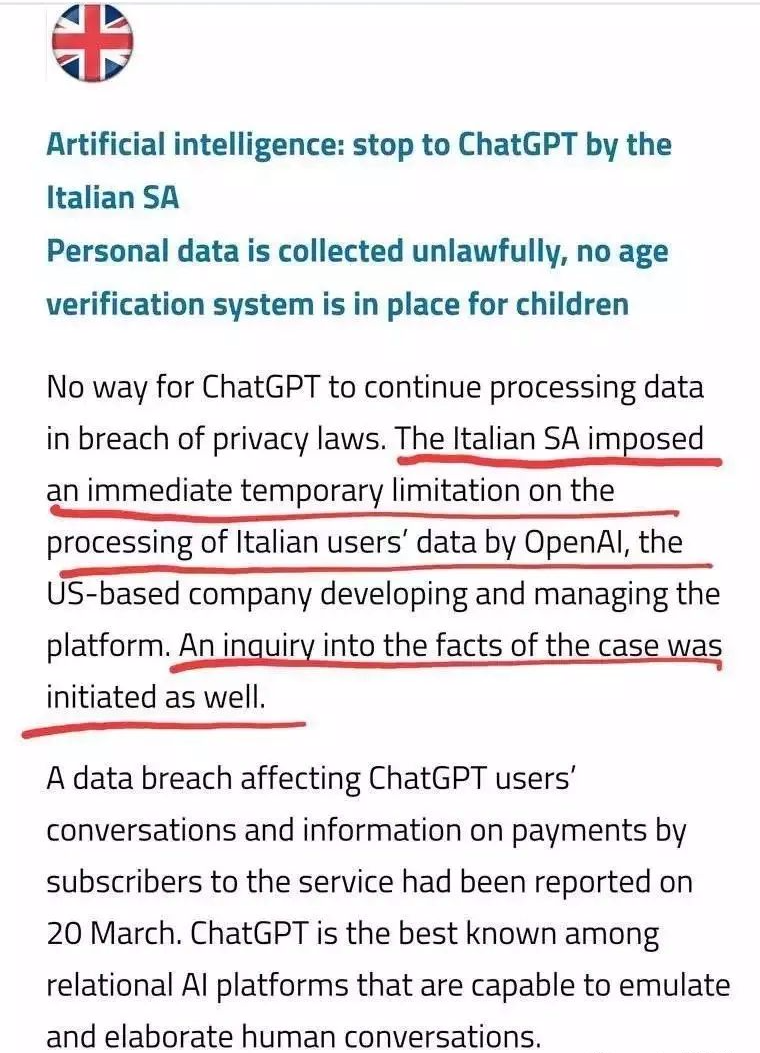

在人工智能与隐私保护问题上,意大利政府于3月31日宣布全面“禁用”ChatGPT,理由是该服务“非法收集个人资料;未成年人年龄核实系统缺失”。

OpenAI作为ChatGPT的开发公司,也受到了行政措施的跟进,如果20天内不能调整到尊重隐私法规的状态,将面临2000万欧元或全球年营业额4%的巨额罚款。

此举被认为是针对ChatGPT的第一枪,也是对于人工智能与隐私保护问题的深度思考和探讨。

过去几年中,人工智能技术迅速发展,ChatGPT作为其中的代表之一,被广泛应用于自然语言处理和对话系统中。然而,这种技术的使用也引发了越来越多的隐私和安全问题。

OpenAI CEO Sam Altman 迅速发推进行回应:“Open AI服从意大利政府的命令,已停止 ChatGPT在意大利的服务(尽管我们认为已遵守了所有隐私相关法律)。意大利仍然是我最喜欢的国家之一,期待再次访问!”

在此之前,马斯克等行业大佬曾呼吁全世界暂停为期6个月的人工智能研究,以缓解其发展所带来的安全问题。而ChatGPT被禁用,则引起了更多对于人工智能与隐私保护问题的关注。

用户数据已成为有价值的资源,未经授权的获取和滥用会带来负面影响。而AI大模型技术的发展,往往需要海量大数据进行支撑,因此,ChatGPT很有可能存在大量收集和存储个人数据的行为,以用于训练算法。

然而,B B C为ChatGPT发声,认为ChatGPT收集信息是为了学习这个世界,而非学习个人用户本身。ChatGPT也回应称不会主动侵犯用户隐私,只会收集一些交互信息并寻求用户授权。

在人工智能与隐私保护问题上,我们需要平衡保护公众安全和维护言论自由的权利,并建立更加安全和可靠的技术和流程来管理人工智能语言模型的使用。

教育公众如何识别和应对网络欺诈和虚假信息也是解决问题的重要方面。禁用一个技术并非解决问题的最佳方式,我们需要考虑其他的解决方案,如建立更加安全和可靠的技术和流程来管理人工智能语言模型的使用,以及教育公众如何识别和应对网络欺诈和虚假信息。

这需要跨部门和跨界的合作和共同努力,以确保我们在利用人工智能技术的同时,能够保护公众的利益和权利。

在ChatGPT被禁用之后,人们也开始重新审视人工智能技术的使用和发展,对于其安全和隐私保护问题也提出更高的要求。未来,如何平衡人工智能与隐私保护问题,是需要全球共同探讨和努力的重要课题。