目前看来,能够颠覆 ChatGPT 的命运的,似乎仍然只有 OpenAI 自己。

在 ChatGPT 在科技领域引起轰动之后,人们一直在探讨 AI 接下来的发展方向。很多学者都提到了多模态技术,而我们并没有等待太久。今天凌晨,OpenAI 推出了多模态预训练大模型 GPT-4。

这次GPT-4的放送非常全面,且内容量极度爆炸!

最令人震惊的是,他们拍了一张手画的网站设计草图,然后GPT-4 直接生成了可以运行的 HTML+CSS 代码。这意味着只要是个会画画的小孩,都可以使用代码实现他们想要的现代化可运行网页,真正让技术赋能每一个有梦想的人。

当然在看文章之前,首先问问它自己。

言归正传

我们看下这篇文章讲了什么逆天的故事。

Open AI首先发布了一篇自己署名的长达98页的论文,接着是一个60页的system card,提供了ChatGPT Plus的试用机会,同时还有API的候补名单,以及一个令人惊叹的开发者演示视频。

但是,这些几乎达到200页的材料中,却并未透露任何技术细节。

署名为OpenAI的论文

system card

GPT-4是什么?

官网对自己的介绍

GPT-4是一个大规模的多模态模型,简单来说就是接受图像和文本输入,发出文本输出。

如果是其它公司的可能大家觉得也不过如此。

但OpenAI出品,你绝对不敢怀疑。它还谦虚地说道,虽然在许多现实世界场景中的能力不如人类,但在各种专业和学术基准上表现出人类水平的表现。

和人类水平差不多的说法,现在也经常听见。

但它继续说道,它通过模拟律师考试,分数在应试者的前 10% 左右;相比之下,GPT-3.5 的得分在倒数 10% 左右。(也是说从班级倒数变成了班级前十,之前我的一篇文章还探讨过ai能不能替代律师,没想到短短半个月,又更新了我的观念。)

它又说它整整花了 6 个月的时间,使用对抗性测试程序和 ChatGPT 的经验教训迭代调整 GPT-4。(虽然这样说,但6个月这也过于快了)从而在真实性、可操纵性方面取得了有史以来最好的结果。

即便如此,他们依然谦虚地说,这远远不够完美。

在基建方面,OpenAI也非常重视,他们重新构建了整个深度学习基础设施,甚至还与Azure(亚马逊)合作。这个工程让我们都不知道OpenAI已经领先我们多少了。他们的GPT-4能够稳定训练,效果甚至是可预测的。

能力提升4.0

GPT-4最突出的特点除了多模态,还在于相比GPT-3.5,它的理解能力和创造力更强,特别是在处理复杂指令时表现出色。

OpenAI进行了大量实验来展示GPT-4的优越性,甚至将其与GPT-3.5进行比较。结果通过展示一堆奥数和AP的题目,通过数据呈现了GPT-4远胜于GPT-3.5的实力。如果只是日常交流,两者的差别可能不太明显,但面对复杂问题,GPT-4的表现可以说是超乎想象。

为了初步了解 GPT-4 在其他语言上的表现,研究团队使用 Azure Translate 将 MMLU 基准测试(涵盖了 57 个主题的 14,000 个多项选择题)翻译成多种语言。在测试的 26 种语言中的 24 其中,GPT-4 的表现优异 GPT-3.5、Chinchilla 和 PaLM 这些大型语言模型。需要注意的是,许多现有的机器学习基准测试都是用英语编写的。

和许多使用 ChatGPT 的公司一样,OpenAI 表示他们内部也在使用 GPT-4。因此,OpenAI 更关注大型语言模型在内容生成、销售和编程等方面的应用效果。同时,OpenAI 还使用 GPT-4 辅助人们评估 AI 输出,这也是 OpenAI 对其策略的第二阶段。

视觉输入MAX

GPT-4很厉害,它不仅能接受文本输入,还可以接受图像输入,这样就可以完成各种语言和视觉任务。

简单来说,只要给它一堆散乱的文本和图像,它就能生成自然语言和代码等文本输出。在处理带有文本和照片的文档、图表或屏幕截图方面,它表现得与纯文本输入一样好。此外,它还使用了一些测试技术来提高纯文本模型的性能,比如少量镜头和思维链提示。

比如给 GPT-4 一张长得很奇怪的充电器的图片,问为什么这看起来很好笑?

GPT-4 也可以理解一张照片里有什么不对劲的地方:

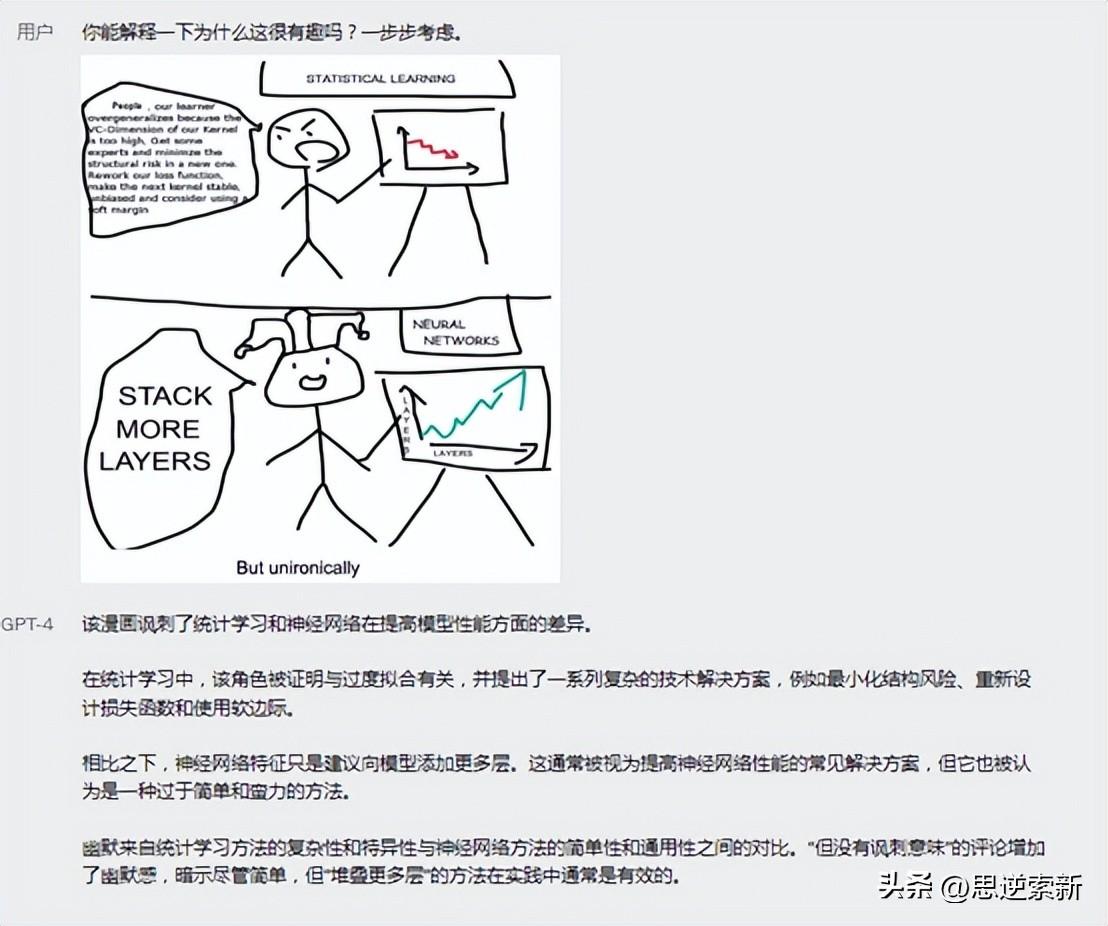

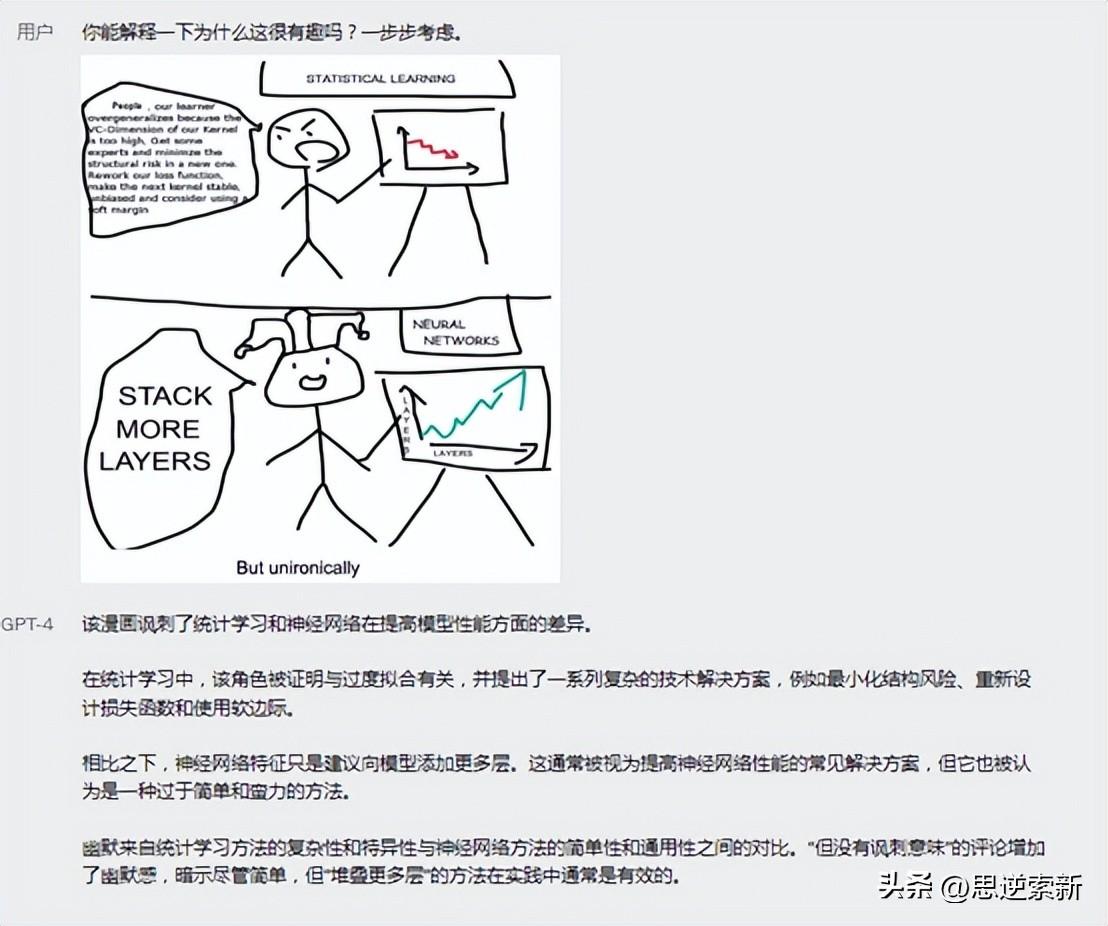

接着来,问 GPT-4 这个梗图是什么意思:

漫画呢?

不过 OpenAI 在这里说了,图像输入是研究预览,仍不公开。

可控性增强

与过去 ChatGPT 的语气和风格个性不同,现在开发人员和 ChatGPT 用户可以通过在“后台”消息中描述他们的 AI 的方向来定义其个性和任务。这个功能使得 API 用户可以在一定程度上自定义 ChatGPT 的用户体验。

OpenAI 知道有些人正在使用 ChatGPT 来玩角色扮演,并鼓励这样做。

虽然 GPT-4 的功能已经非常强大,但它仍然存在一些限制,最重要的是它并不完全可靠。OpenAI 表示,GPT-4 仍然可能会产生幻觉、生成错误答案,并出现推理错误。

使用语言模型时,应该谨慎审查输出内容,并在必要时使用特定用例需求相匹配的协议(例如人工审查、附加上下文或完全避免使用)。

总体来说,相较于以前的模型,GPT-4 已经显著减轻了幻觉问题。在 OpenAI 对其进行的内部对抗性真实性评估中,GPT-4 的得分比最新的 GPT-3.5 模型高出了40%。

GPT-4 能力很强大,但它也有些盲区,不了解2021年9月以后发生的事件,也不能从经验中学习。有时它会做出简单的推理错误,或者过于轻信用户的虚假说法。有时候它也会像人类一样遇到困难,比如在生成代码时引入安全漏洞。GPT-4 在预测时也可能出错,但它很自信,即使意识到可能出错也不会二次检查。

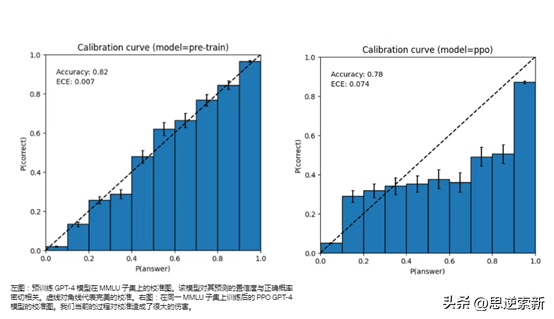

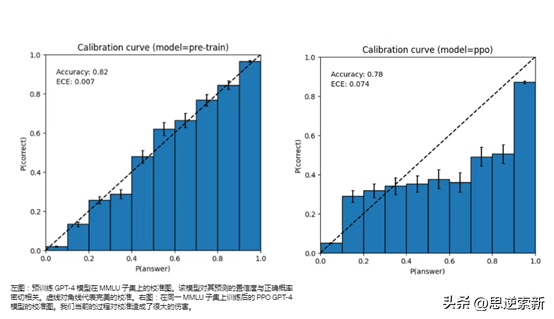

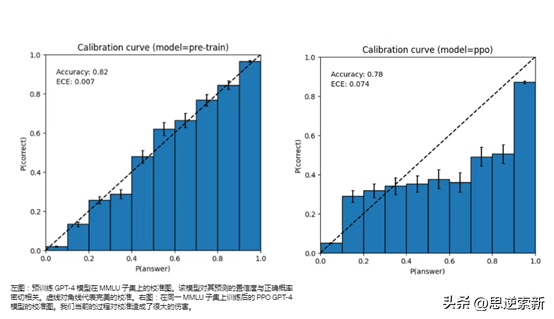

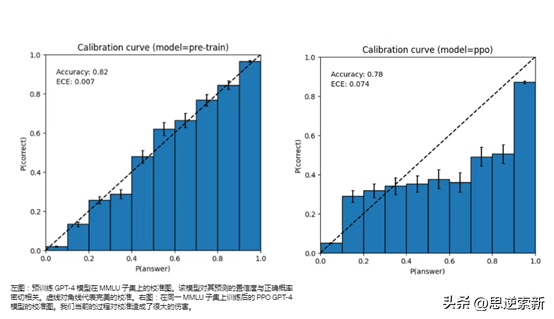

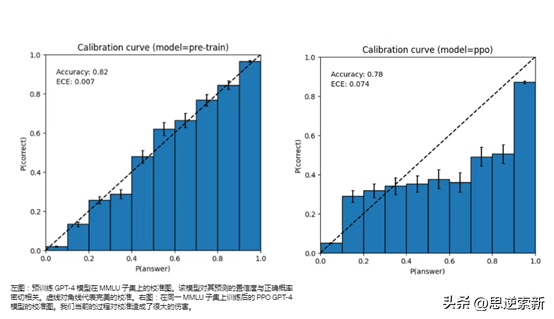

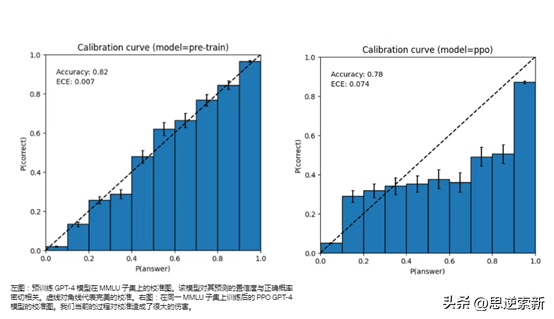

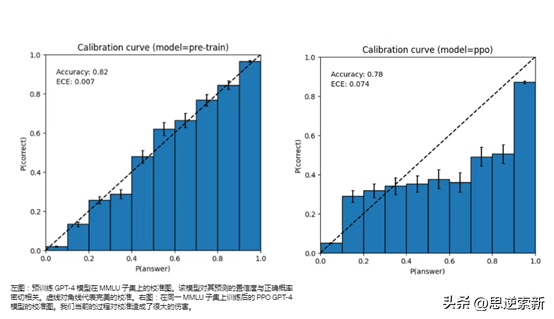

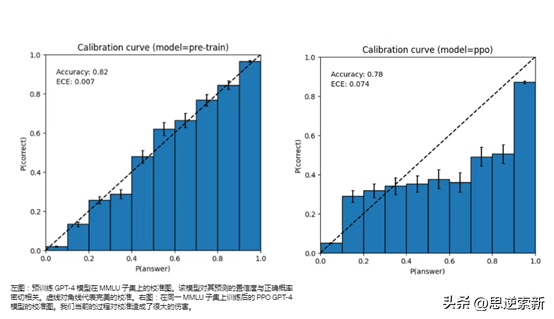

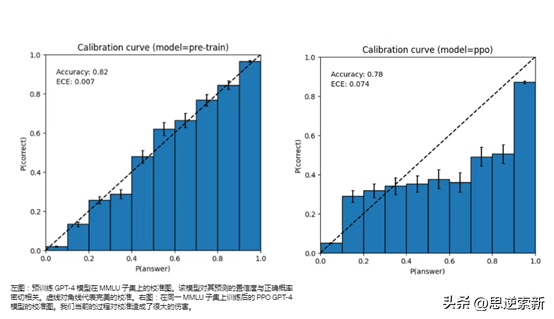

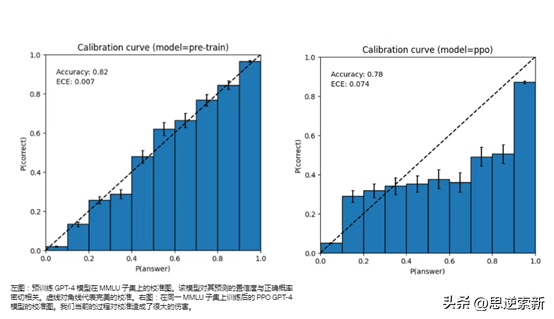

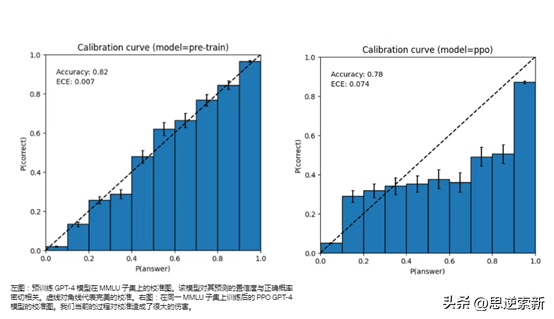

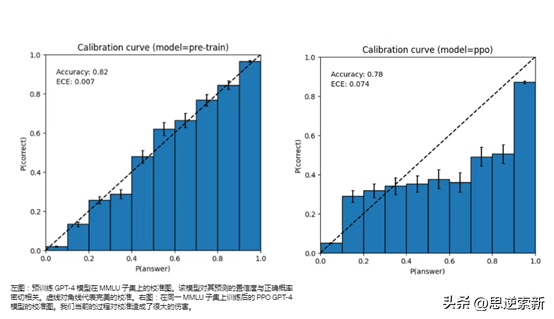

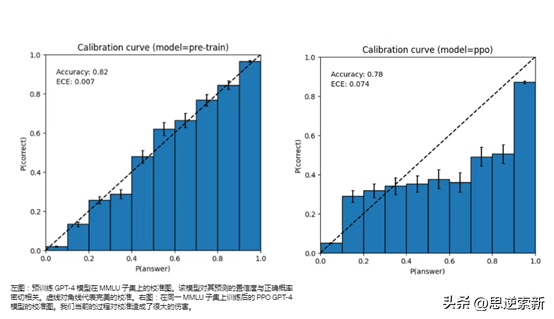

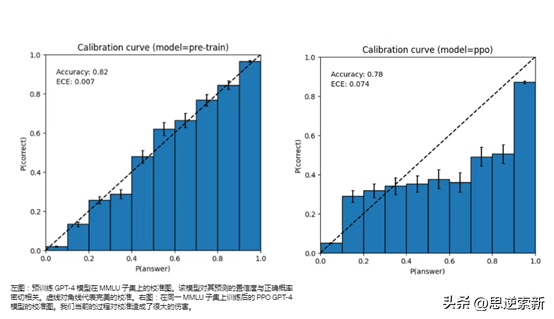

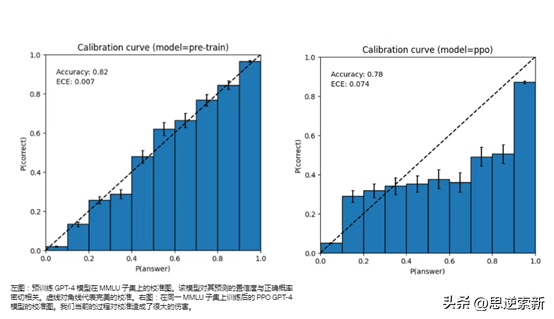

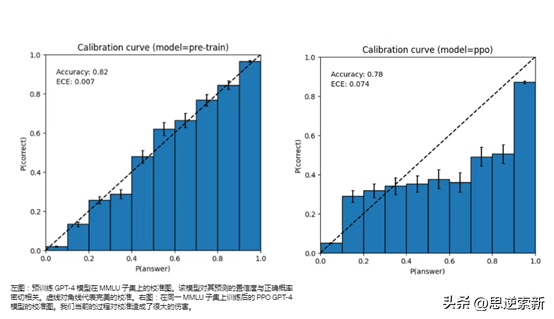

有趣的是,尽管基础预训练模型通常能够高度校准(即其对答案的预测置信度通常与正确概率相匹配),但通过 OpenAI 目前的后训练过程,校准程度有所下降。

如何将ChatGPT至 GPT-4版

OpenAI 在发布 GPT-4 后,直接将 ChatGPT 进行了升级。ChatGPT Plus 的订阅用户可以在 chat.openai.com上获得 GPT-4 的使用权限,但使用次数有上限。

如果想要使用 GPT-4 的 API,用户需要先注册并等待 OpenAI 的邀请。目前,OpenAI 仅邀请部分开发者参与体验。

一旦获得了访问权限,用户可以向 GPT-4 模型发出纯文本请求(图像输入仍处于 alpha 阶段)。

每 1K 个 prompt token 价格为 0.03 美元,每 1K 个 completion token 价格为 0.06 美元。而且默认速率限制为每分钟 40K 个 token 和每分钟 200 个请求。GPT-4 可以处理的上下文长度为 8,192 个 token。此外,OpenAI 还提供了长度为 32,768 个 token 的版本(约 50 页文本)的有限访问,该版本也将随着时间自动更新(当前版本是 gpt-4-32k-0314,支持到 6 月 14 日)。不过,这个版本的价格比较高,每 1K prompt token 的价格为 0.06 美元,每 1K completion token 的价格为 0.12 美元。

令人不满的一点是,OpenAI 公开的技术报告中,不包含任何关于模型架构、硬件、算力等方面的更多信息,可以说是很不 Open 了。

不管怎样,迫不及待的用户大概已经开始测试体验了吧。

注:为方便读者阅读,从官网所截取部分图片经过机器翻译,可能会造成内容的缺失和错误,不代表原文真正的含义

我是新君,创作不易,觉得文章不错希望能点个赞,如果你有更多的想法欢迎评论!

关注我,为你带来更多有趣的知识分享!